ControlNetとT2I-アダプターの例

これらの例では、元の画像が直接ControlNet/T2Iアダプターに渡されていることに注意してください。

各ControlNet/T2Iアダプターは、特定のフォーマットの画像(深度マップ、エッジ検出など)を必要とします。これは具体的なモデルによって異なり、良い結果を得たい場合は重要です。

ControlNetApplyノードは、通常の画像を深度マップやエッジ検出画像などに変換しません。これらの変換は別途行う必要があります。または、ここで見つけることができるノードを使用して画像を前処理することができます。

最新のcontrolnetモデルファイルは以下で見つけることができます:オリジナルバージョン または より小さなfp16 safetensorsバージョン

SDXLについては、stability.aiがControl Lorasをリリースしており、こちら(rank256)またはこちら(rank128)で見つけることができます。これらは通常のControlNetモデルファイルと全く同じように使用できます(同じディレクトリに配置します)。

ControlNetモデルファイルはComfyUI/models/controlnetディレクトリに配置します。

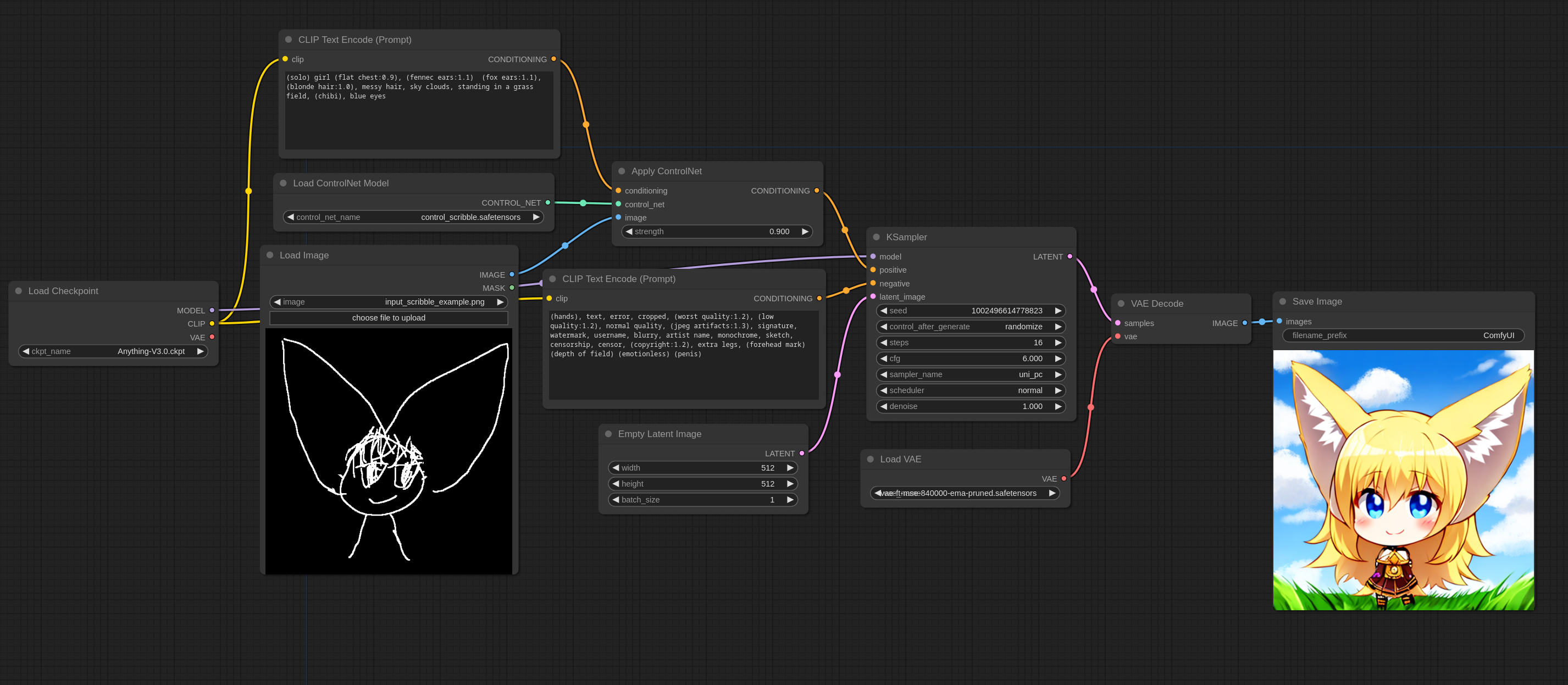

落書きControlNet

これはcontrolnetsの使用方法の簡単な例です。この例では落書きcontrolnetとAnythingV3モデルを使用しています。ComfyUIでこの画像を読み込むと、完全なワークフローを取得できます。

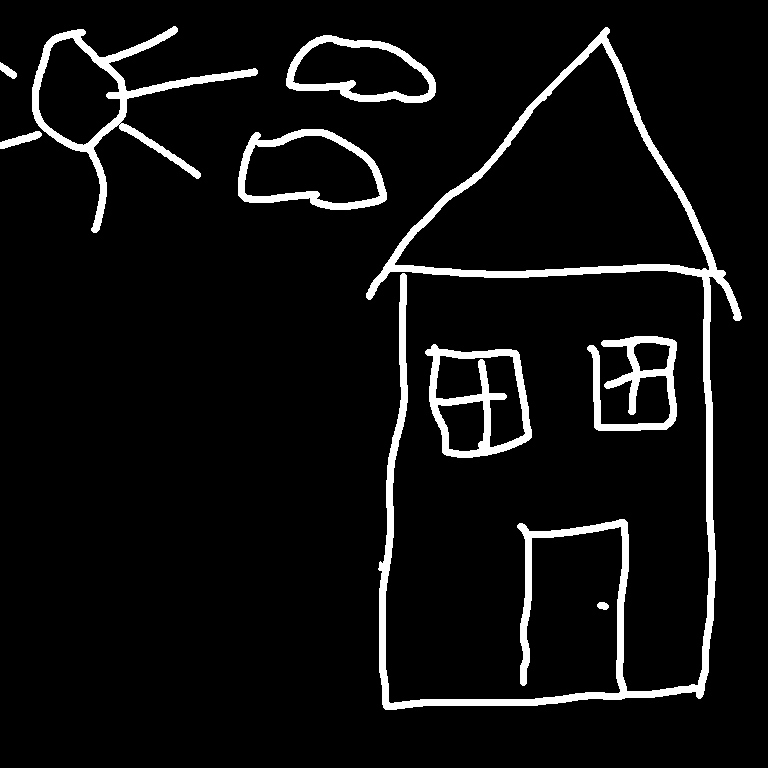

これはこのワークフローに使用した入力画像です:

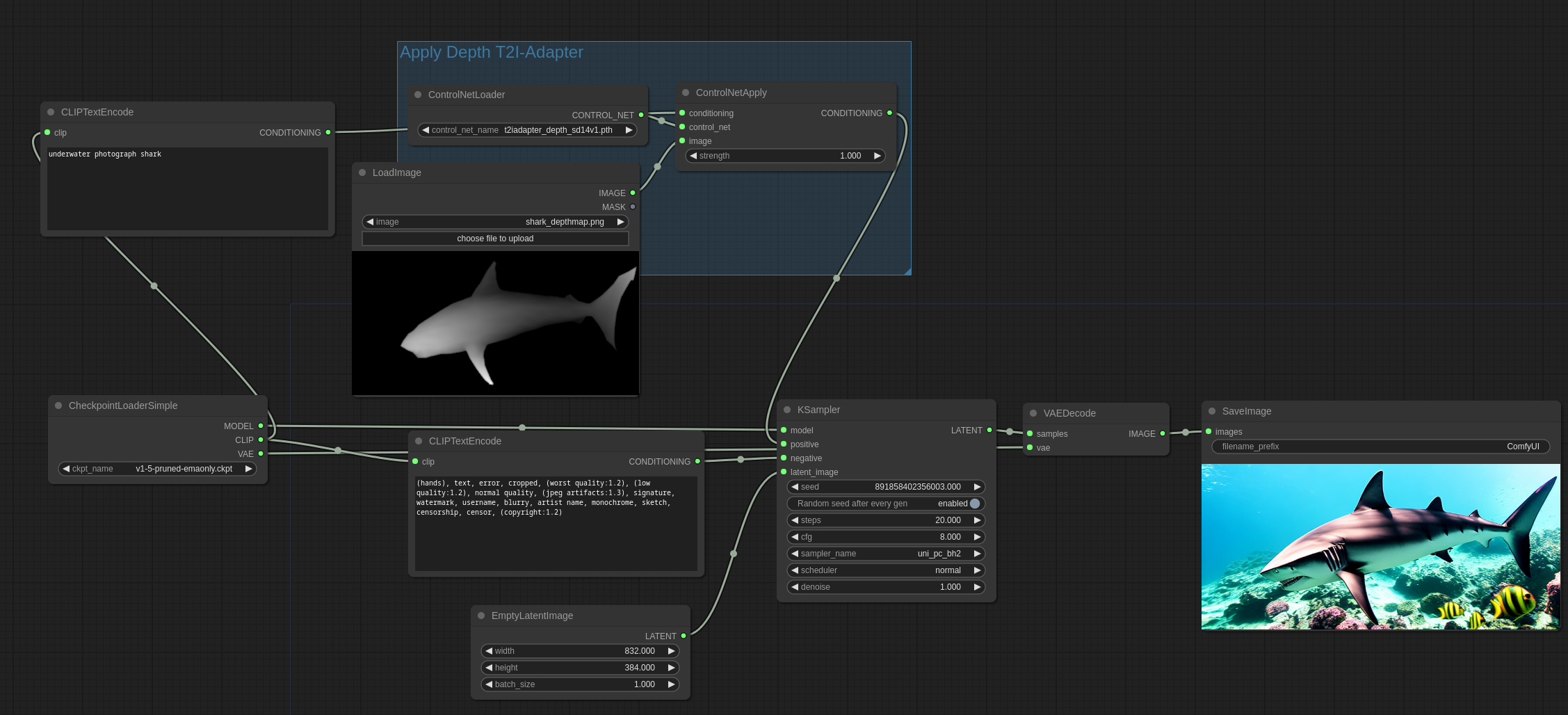

T2I-アダプターとControlNets

T2I-アダプターはControlNetsよりもはるかに効率的であるため、強くお勧めします。ControlNetsは生成速度を大幅に低下させますが、T2I-アダプターはほとんど生成速度に悪影響を与えません。

ControlNetsでは、ControlNetモデルが各イテレーションで1回実行されます。T2I-アダプターでは、モデルは合計で1回だけ実行されます。

T2I-アダプターはComfyUIでControlNetsと同じ方法で使用されます:ControlNetLoaderノードを使用します。

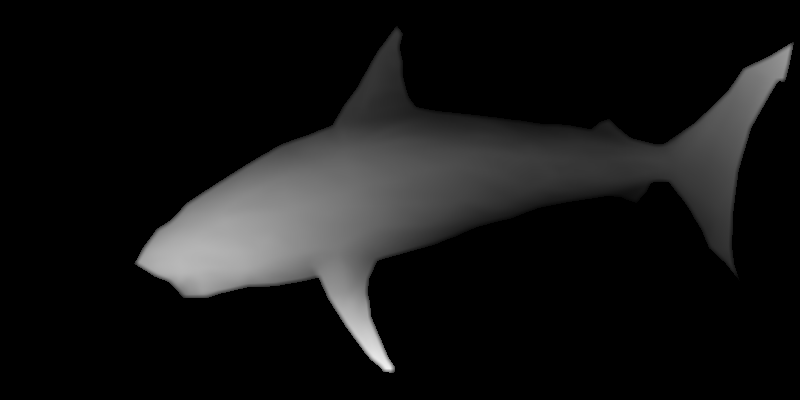

これはこの例で使用される入力画像です ソース:

これは深度T2I-アダプターの使用例です:

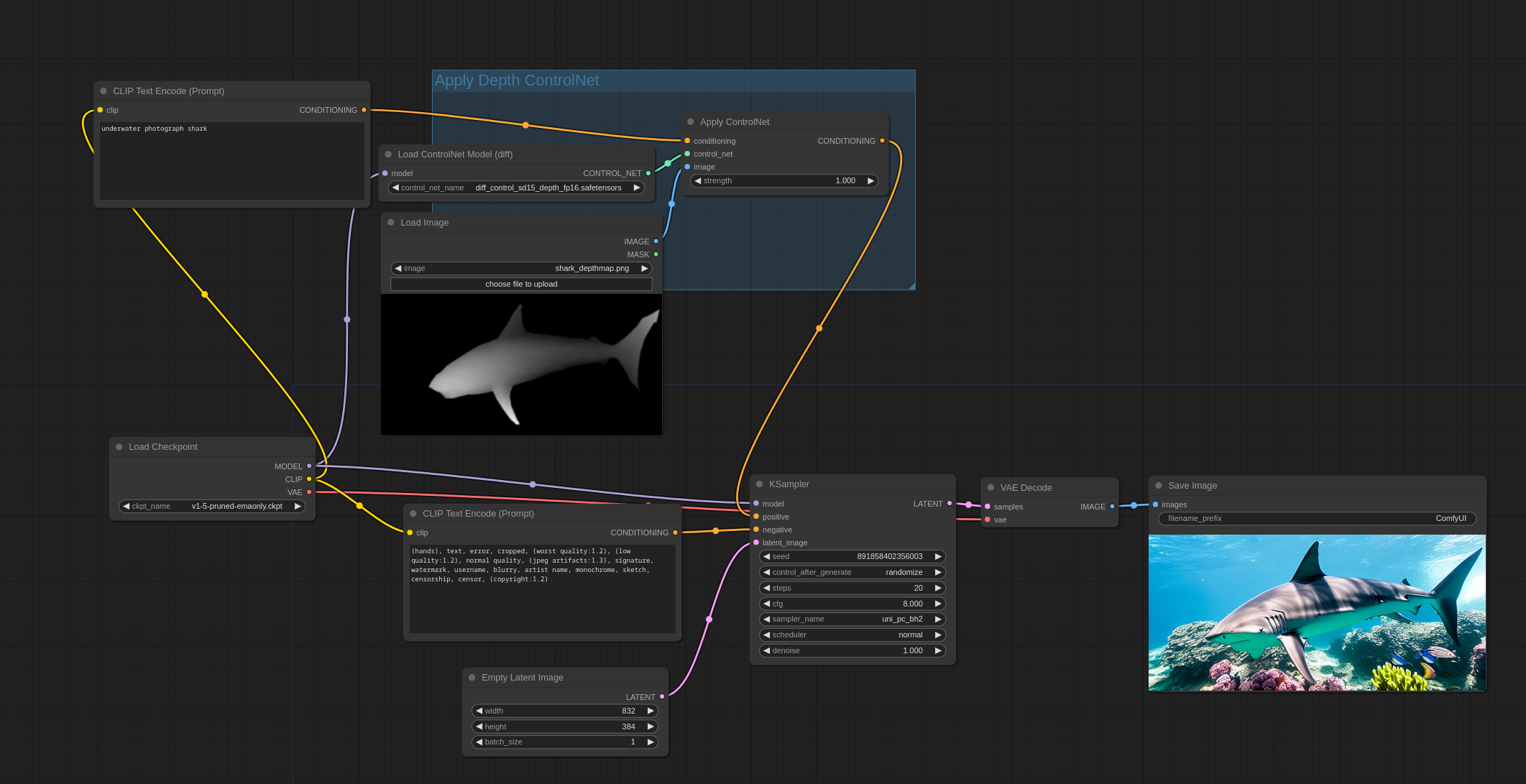

これは深度Controlnetの使用例です。この例ではDiffControlNetLoaderノードを使用していることに注意してください。これは使用されているcontrolnetが差分controlnetであるためです。差分controlnetsは正しくモデルの重みを読み込む必要があります。通常のcontrolnetモデルを読み込む場合、DiffControlNetLoaderノードはControlNetLoaderノードと同じように動作します。

ComfyUIでこれらの画像を読み込むと、完全なワークフローを取得できます。

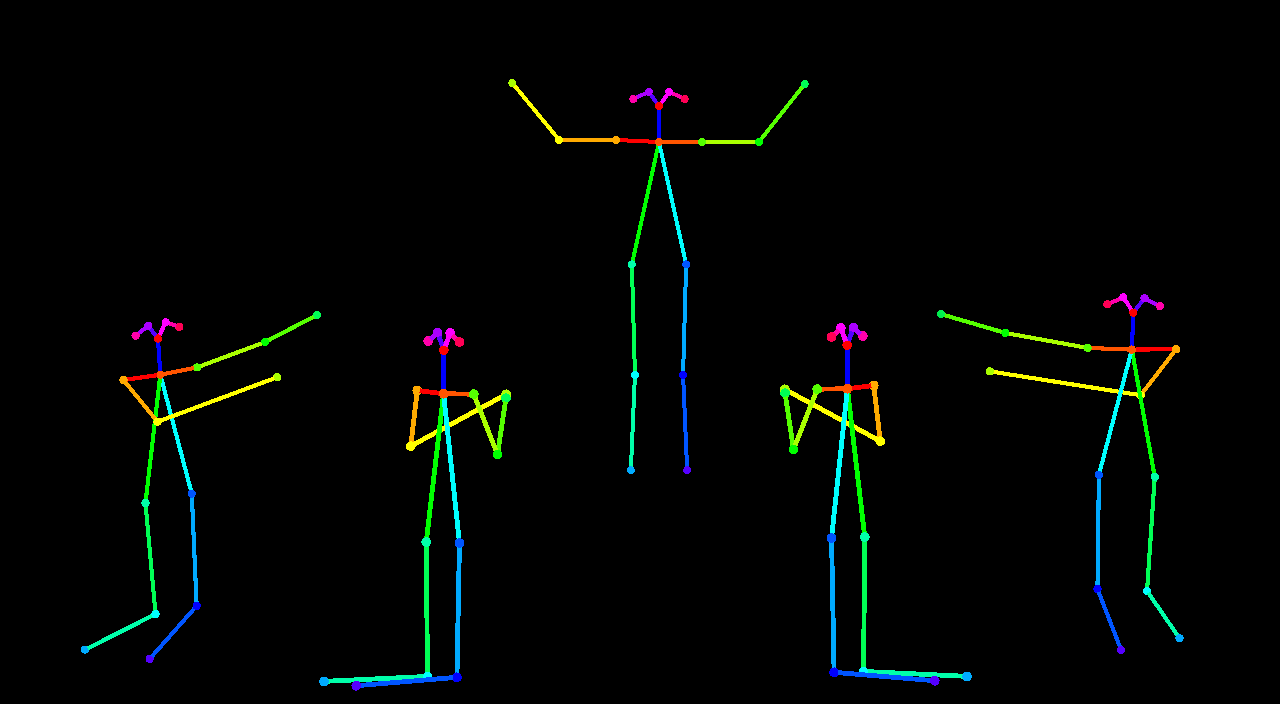

ポーズControlNet

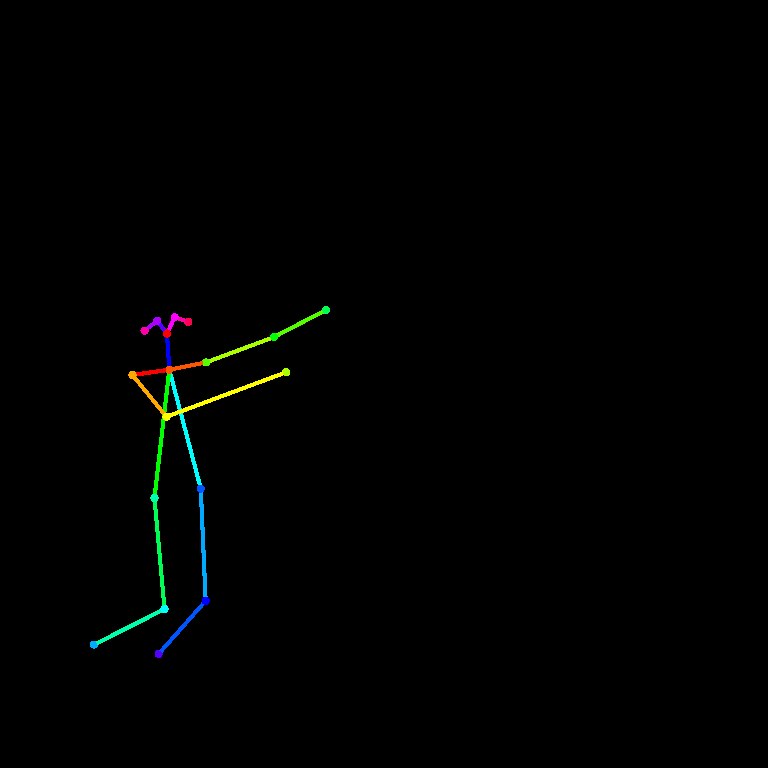

これはこの例で使用される入力画像です:

これは、AnythingV3を使用して最初のパスを行い、controlnetを使用して2回目のパスを行う例です。2回目のパスではcontrolnetを使用せず、AOM3A3(Abyssorangemix 3)とそのVAEを使用しています。

ComfyUIでこの画像を読み込むと、完全なワークフローを取得できます。

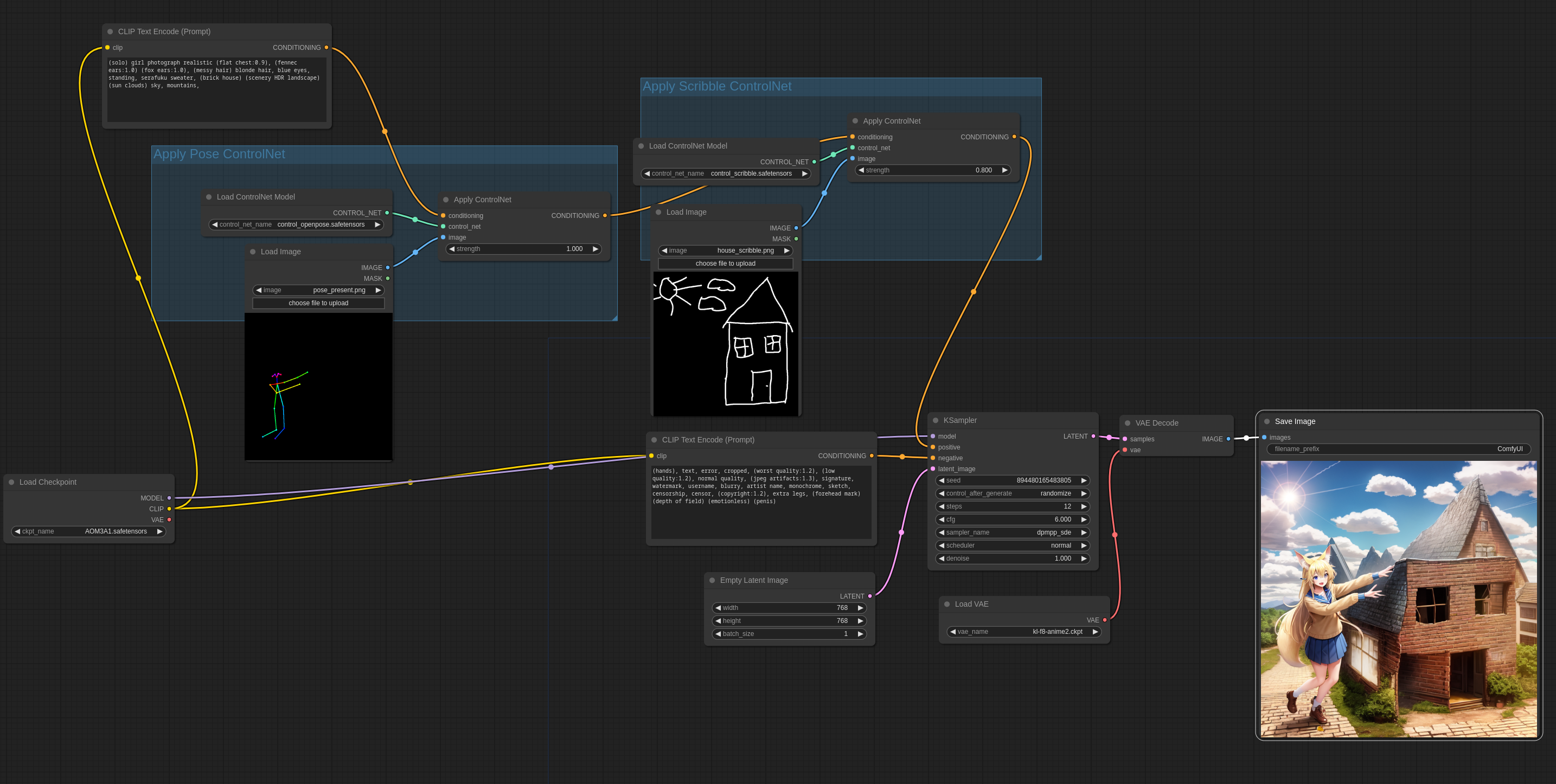

ControlNetsの混合

複数のControlNetsとT2I-アダプターを適用して、興味深い結果を得ることができます:

ComfyUIでこの画像を読み込むと、完全なワークフローを取得できます。

入力画像: